Sie beantworten Fragen rund um die Uhr, brauchen keine Ferien, noch werden sie krank. Sie sind günstiger als die Supportmitarbeiter und lernen grösstenteils selbstständig. Klauen uns die Bots den Job? Experten winken ab! Nein, wir werden in Zukunft immer mehr zusammenarbeiten.

Wikipedia definiert ein Bot als «Computerprogramm, das weitgehend automatisch sich wiederholende Aufgaben abarbeitet, ohne dabei auf eine Interaktion mit einem menschlichen Benutzer angewiesen zu sein». Bots, dessen Name übrigens vom Englischen «Robot» (Roboter) ableitet, sind keine neue Modeerscheinung. Die autonom agierenden Programme kennen wir seit der Geburt des Internets von den Suchmaschinen wie Google & Co. So genannte Webcrawler durchsuchen das Internet und indexieren die Webseiten, damit diese schnell gefunden werden.

Das Image der Bots ist angekratzt! Schuld daran sind sogenannte Botnets – so nennt man mehrere Bots, die miteinander kommunizieren –, die zum Sammeln von E-Mail-Adressen und versenden von Spam Nachrichten wie Fake News, Werbung, etc. missbraucht werden. Schlussendlich ist es der Mensch, der entscheidet, für welchen Zweck der Bot genutzt wird. Es gibt Einsatzbereiche, an denen so genannte Chatbot längst zum Alltag gehören und wertvolle Arbeit verrichten:

- Die sprachgesteuerten Assistenten wie Apple’s Siri, Amazon’s Alexa, Microsoft’s Cortana oder Google’s Assistant sind nichts anderes als Chatbots.

- Bei Fluggesellschaften und Online-Reisebüros beantworten vielfach Chatbots Fragen zu Flügen, Freigepäck, Flugstatus, Flugmeilen, etc.

- Eine breite Palette von Bots gibt es im Einzelhandel als Unterstützung bei der Produktauswahl, z.B. um ein passendes Geschenk zu finden oder eine Farbauswahl für Haare und Makeup zu treffen.

- Auch Lebensmittelmarken haben Chatbots für sich entdeckt, um z.B. Menübestellungen entgegen zu nehmen, Restaurants zu finden oder Rezeptfragen zu beantworten.

- Viele Banken und Kreditunternehmen nutzen Chatbots für Auskünfte über Kontostände oder um Zahlungen auszulösen.

Haben Sie gewusst, dass die Bankenbranche bezüglich der Chatbot-Technologie am weitesten fortgeschritten ist? Kürzlich hatte die Raiffeisenbank einen Chatbot namens Casalino als Hypothekenberater vorgestellt. Casalino, welcher anhand der Fragen und Antworten selber dazulernte, wurde zuerst von internen Mitarbeitern trainiert. Einerseits musste er «lernen» die Fragen zu verstehen und andererseits die richtigen Antworten zu finden. Diese Lernphase, bevor er den Kunden zur Verfügung stand, bezeichnet Fabian Schmid, Projektleiter des Chatbot Experiments, als Schlüsselpunkt. Es sei zwar sehr aufwendig, aber in der Anfangsphase wichtig, dass jede Antwort, oder zumindest die Materialen, aus denen die Antworten generiert werden, Menschen kontrollieren.

Microsoft musste diese Erfahrung im 2016 schmerzhaft machen und einen Versuch mit Chatbot «Tay» nach wenigen Stunden abbrechen. Eigentlich sollte Tay von anderen Nutzern lernen, wie junge Menschen sprechen. Doch die Nutzer fütterten den Chatbot vor allem mit rassistischen Inhalten, die Tay aufgriff und wiederholte.

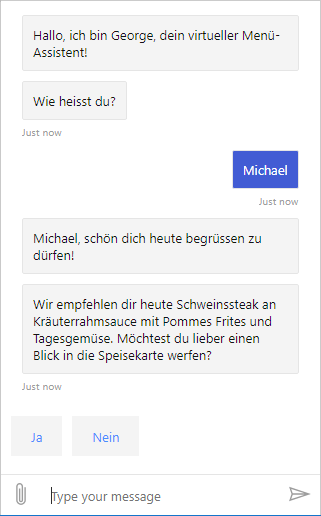

Geführter Dialog mit Texteingabe und Antwortauswahl

Geführter Dialog mit Texteingabe und Antwortauswahl

Die Programmierung ist am einfachsten, wenn der Chatbot die Konversation führt und nach einem vordefinierten Muster die Fragen stellt. Kennt der Chatbot nebst den Fragen auch die Antworten, wie z.B. bei einer Menübestellung, können dem Kunden Vorschläge aufgelistet werden, welche er nur noch auswählen, resp. antippen muss. Nebst der schnelleren Rückmeldung entfällt auf diese Weise das Eintippen und somit allfällige «Verständigungsprobleme».

Etwas schwieriger wird es, wenn der Kunde frei antworten, oder nebst der Tastatur die Sprachsteuerung nutzen kann. Wichtig ist eine exakte Fragestellung, damit eine korrekte Interpretation der Antworten möglich wird. Verfügt der Chatbot zusätzlich über künstliche Intelligenz (KI), wirkt er menschlicher und ermöglicht eine freie Konversation. Entwickler, die selber nicht über das nötige Know How oder Budget verfügt, können z.B. die KI-Dienste der grösseren Cloud Anbieter nutzen. Die Microsoft Cloudplattform Azure stellt eine Vielzahl von kognitiven Funktionen zur Verfügung, die sehr einfach in die eigene Anwendung integriert werden können.

Wie der Name bereits vermuten lässt, basiert der QnA (Question and Answer) Maker Dienst auf einer Wissensdatenbank, aus der er die Antwort mit der höchsten Trefferwahrscheinlichkeit auswählt. Die Frage-Antwort-Paare können aus FAQ’s, Produkthandbücher oder Dokumenten extrahiert werden. Anschliessend muss der Dienst mit Fragen trainiert werden, in dem die Antwort mit der höchsten Trefferwahrscheinlichkeit bewertet, resp. korrigiert wird. Es besteht die Möglichkeit, alternative Fragen oder eine präzisere Antwort hinzufügen. Der QnA Maker sollte jedoch nicht durch zu explizite Fragen übertrainiert werden, da sich dadurch der Spielraum verkleinert und das Ergebnis verschlechtert.

Language Understanding (LUIS) ist ein weiterer cloudbasierter Dienst, der benutzerdefinierte Machine Learning-Intelligenz auf natürliche Konversationssprachtexte eines Benutzers anwendet, um die relevanten Informationen herauszufiltern.

Als Beispiel definieren wir eine Reise-App als unsere Domäne. Nun gilt es, Absichten zu finden. Eine Absicht stellt eine Aufgabe oder Aktion dar, z.B. «Flug buchen». Für jede Absicht sind möglichst viele, eindeutige Äusserungen zu suchen:

- Buche mir einen Flug nach Mailand in der nächsten Woche

- Am 15. Juni möchte ich mit SWISS nach Paris fliegen

- Ich benötige am Wochenende ein Flugticket von Zürich nach München

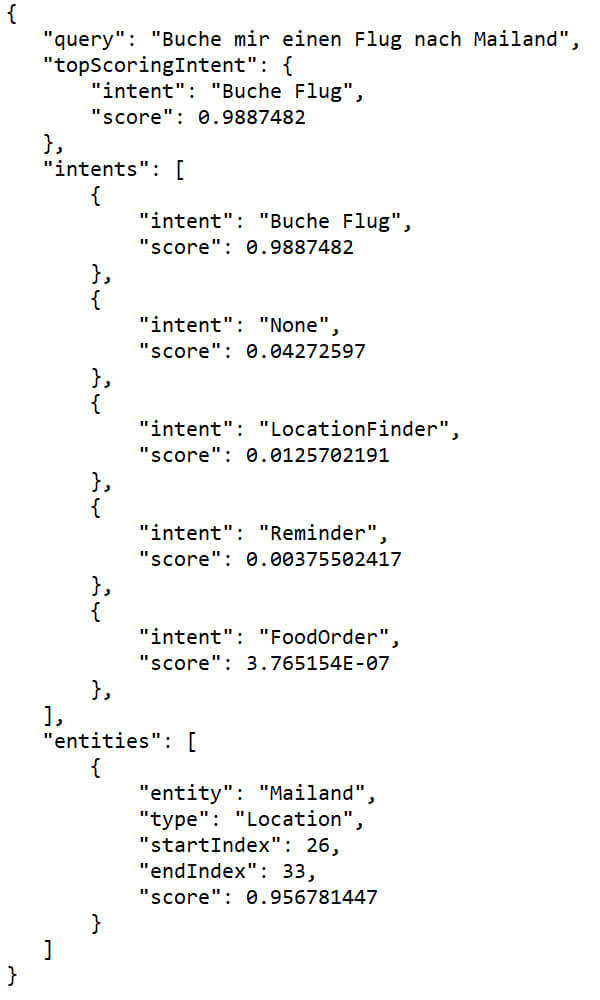

Die Äusserungen helfen dabei, die Entitäten zu identifizieren, welche extrahiert werden sollen und somit für das Erreichen der Absicht wichtig sind. Um einen Flug zu buchen benötigt man Informationen wie Abflugort, Reiseziel, Datum, Fluggesellschaft, Ticketkategorie, etc. Aufgrund dieses Modells analysiert LUIS die Benutzeranfrage und liefert eine JSON Datei, die bewertete Absichten enthält.

JSON Datei mit bewerteten Absichten

JSON Datei mit bewerteten Absichten

Mit fast 99% ist sich LUIS sicher, dass man einen Flug nach Mailand buchen möchte. Durch aktives Lernen wird die Qualität der Sprachmodelle immer besser. Bei jeder Verarbeitung lernt LUIS dazu, sodass man das Modell ständig optimieren und aktualisieren kann.

Die autonom agierenden Computerprogramme sind teils so raffiniert programmiert, dass es für die Nutzer sehr schwierig ist, diese zu identifizieren. Damit man nicht plötzlich einen Vertrauensbruch erleidet, ist es unerlässlich, dass man dem Nutzer mitteilen, dass er mit einem Bot interagiert. Es gibt kein Gesetz, das den Einsatz von Bots verbietet, jedoch könnten die Lizenzbestimmungen der genutzten Plattform den Einsatz von Bots nicht erlauben. Bei sozialen Netzwerken ist zu beachten, dass die Nutzungsbedingungen häufig ändern und deshalb die Bot-Aktivitäten zyklisch geprüft werden müssen. Durch die Interaktion mit dem Kunden sammelt der Chatbot automatisch Daten, was datenschutzrechtliche Fragen aufwirft. Vor dem Einsatz müssen die jeweiligen Datenschutzbestimmungen geprüft werden.

Ob sich ein Bot für ein Unternehmen lohnt, hängt von verschiedenen Faktoren ab. Fakt ist, dass die Akzeptanz von Chatbots bei Konsumenten steigt. Laut Gartner werden bis 2020 die Hälfte aller Mittel- und Grossunternehmen Chatbots einsetzen. Überlegen Sie sich, welche Aufgabe der Chatbot erledigen soll und ob dabei ein Mehrwert für die Firma und die Kunden entsteht. Es nützt nichts, wenn der Chatbot eine geniale Funktionalität zur Verfügung stellt, der Nutzer aber z.B. zuerst eine Kundenummer eingeben muss, die er sehr wahrscheinlich nicht kennt oder parat hat!

Nehmen Sie an unserem Experiment teil und testen SiGi, unser HSiG Bot.